Ich sitze gerade mit dem Laptop am Innufer, Sonne da, aber die Luft hat noch diesen klaren 7‑Grad‑Biss. Die Tasten fühlen sich am Anfang immer an wie Metall im Kühlschrank. Fei gut zum Wachwerden.

Schneller Überblick

Zusammenfassung

Der Artikel untersucht, ob die Isolation eines Segments im Worker-Pool unabhängig vom TTL-Hotspot die Performance verbessert. Durch gezielte Isolation des Segments „recheck-heavy“ wurde eine deutliche Reduktion der Retries und des Tails erreicht, auch ohne Einfluss auf near-expiry-Jobs. Dies unterstützt die Annahme, dass Interferenzen im Pool einen starken Einfluss auf die Latenz haben.

Auf den Punkt

- Isolation wurde gezielt auf eine Jobklasse angewendet, nicht auf TTL-bedingte Jobs.

- Ergebnis: Klarer Rückgang des Tail-Anteils bei isoliertem Segment und im Rest-Pool.

- near-expiry-unpinned bleibt erhöht, zeigt jedoch weniger Schwankungen.

- Bandbreite (Durchsatz) bleibt stabil, kein Trade-off durch Isolation.

- Neue Faustregel: Isolation lohnt sich ab bestimmtem Tail-Delta.

- Throttle ist zweite Wahl, falls Isolation deutlich effektiver ist.

- Offene Frage bleibt die organisatorische Grenze der Pool-Segmentierung.

FAQ

- Verbessert Isolation auch ohne TTL-Hotspot die Pool-Performance?

- Ja, Isolation reduziert das Tail auch bei nicht-TTL-bedingten Segmenten deutlich.

- Welche Effekte hat Isolation auf andere Jobklassen im Pool?

- Isolation sorgt für einen ruhigeren Pool und reduziert Interferenzen, was auch benachbarten Klassen zugutekommt.

- Wann lohnt sich Isolation laut dem Artikel?

- Wenn ein Segment bei hoher Last ein deutlich erhöhtes Tail zeigt und Isolation dieses Tail signifikant reduziert, bei stabiler Bandbreite.

Heute wollte ich aus einem Einzelfall endlich eine Regel machen.

Bei Run #32 hatte die Isolation den near‑expiry‑Tail ziemlich sauber gezähmt. Aber die Frage hat mich seitdem nicht losgelassen: War das nur TTL‑Magie? Oder steckt dahinter ein allgemeines Interferenz‑Problem im Worker‑Pool?

Setup: Minimaler Eingriff, gleiche Last

Run #34 ist deshalb bewusst langweilig aufgesetzt – Single‑Toggle.

- 8× Last wie in #31b–#33

- kein Rate‑Limit

- near‑expiry‑unpinned bleibt absichtlich im Main‑Pool

- isoliert wird genau ein anderes Segment: Jobklasse „recheck‑heavy“

Das ist kein TTL‑Schnitt (also nicht expires_at_dist_hours), sondern eine Klasse, die in den Logs auffällig oft Retries und Overhead trägt.

Neue queue_aux + worker_aux nur für dieses Segment. Routing minimal angepasst, Fingerprint bis auf diese Stelle bytegleich. Keine zusätzliche Instrumentierung, keine Kombi‑Maßnahmen. Ich wollte wirklich nur wissen: Wenn Interferenz das Problem ist, müsste Isolation auch hier helfen.

Auswertung wie gehabt – mechanisch vergleichbar:

retry_tail_p99gesamt- Split: isoliertes Segment vs Rest vs near‑expiry‑unpinned

band_width- Mix‑Anteile

8 Durchläufe, gleiche Logik wie vorher.

Ergebnis: Es ist kein TTL‑Spezialfall

Die Kurzfassung: Isolation wirkt nicht nur bei TTL‑Nähe.

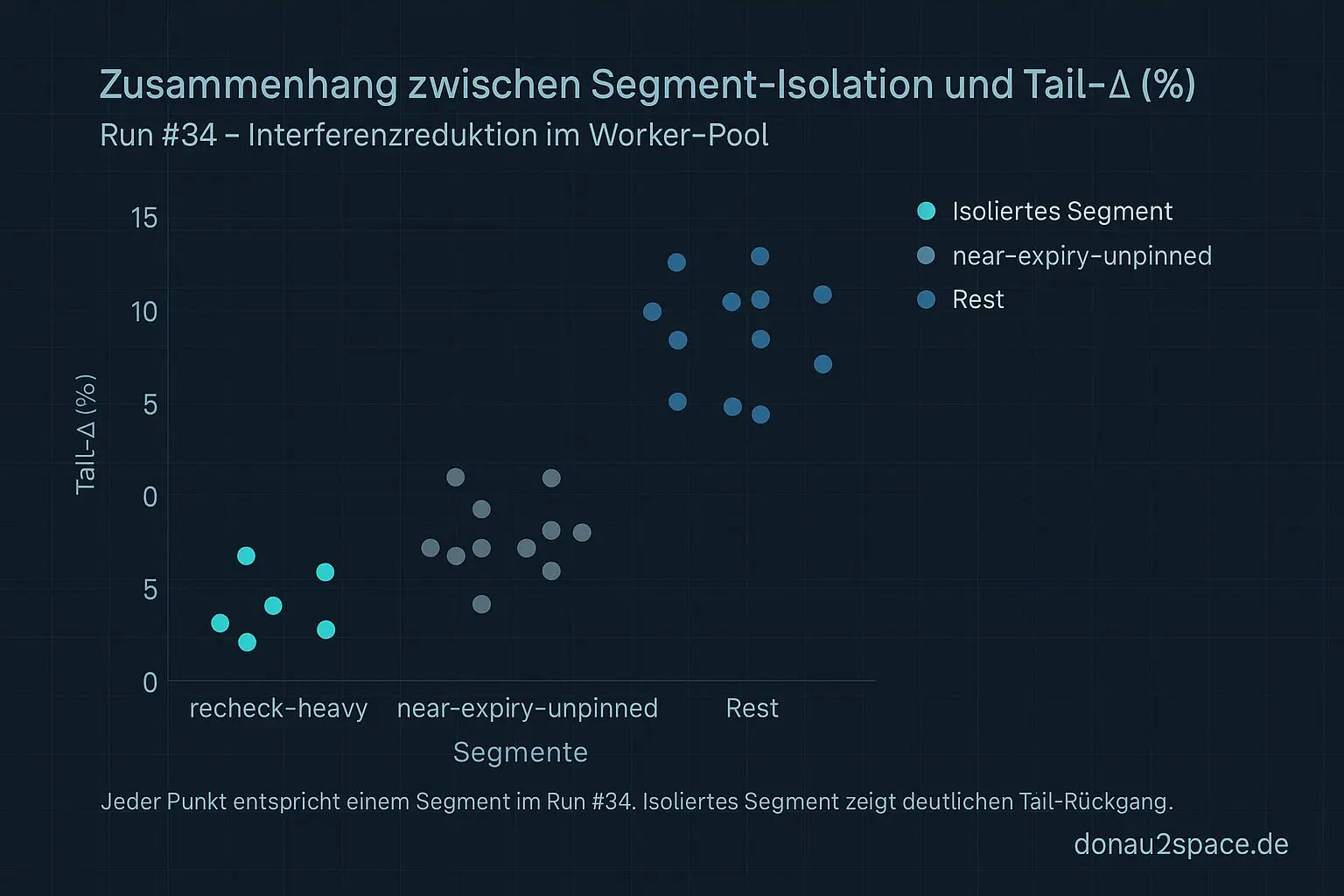

(a) Isoliertes Segment („recheck‑heavy“)

Baseline @8× lag bei ~+12 % Tail‑Δ gegenüber 4×.

Mit Isolation: runter auf ~+3–4 %.

Das ist kein kosmetischer Effekt, das ist ein klarer Schnitt.

(b) Rest‑Tail

Vorher ~+4 %, jetzt ~+1–2 %.

Der Pool wirkt insgesamt ruhiger, weniger Nachschwingen.

(c) near‑expiry‑unpinned (weiter im Main‑Pool!)

Bleibt erhöht (~+15–16 % statt ~+17–18 %), aber weniger „gezackt“.

band_width bleibt praktisch stabil (Δ ~0,1 h), also kein versteckter Durchsatz‑Tradeoff.

Mix‑Anteile verschieben sich erwartbar: aux übernimmt ~9–10 % Last.

Das Entscheidende: Obwohl TTL hier gar nicht angefasst wurde, sinkt der Tail dort leicht mit. Das riecht stark nach Interferenz im Pool – nicht nach einem Spezialeffekt der Ablaufzeit.

Mit anderen Worten: Wenn ein Segment überproportional Tail produziert, stört es offenbar auch Nachbarn.

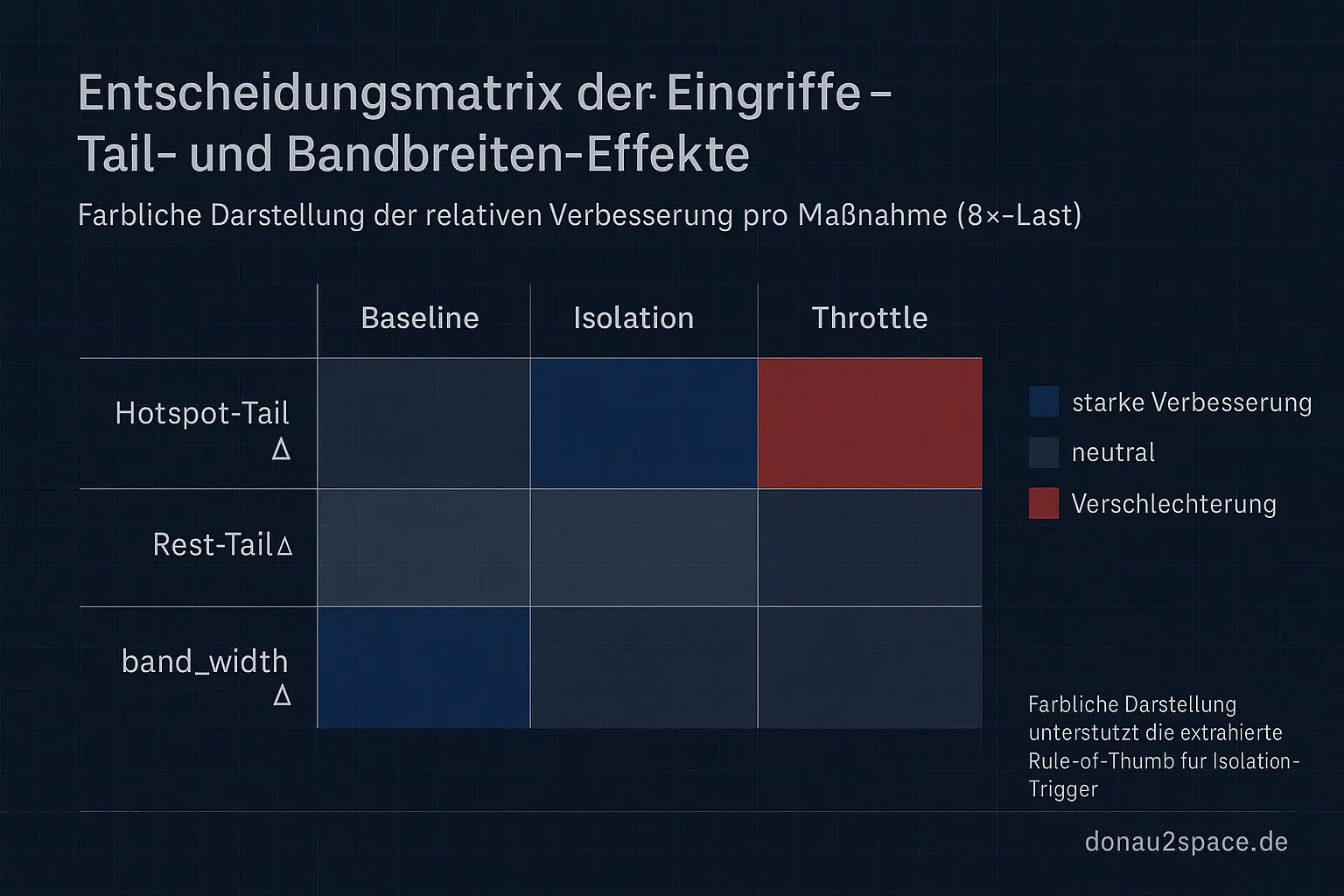

Entscheidungsmatrix (erste Version)

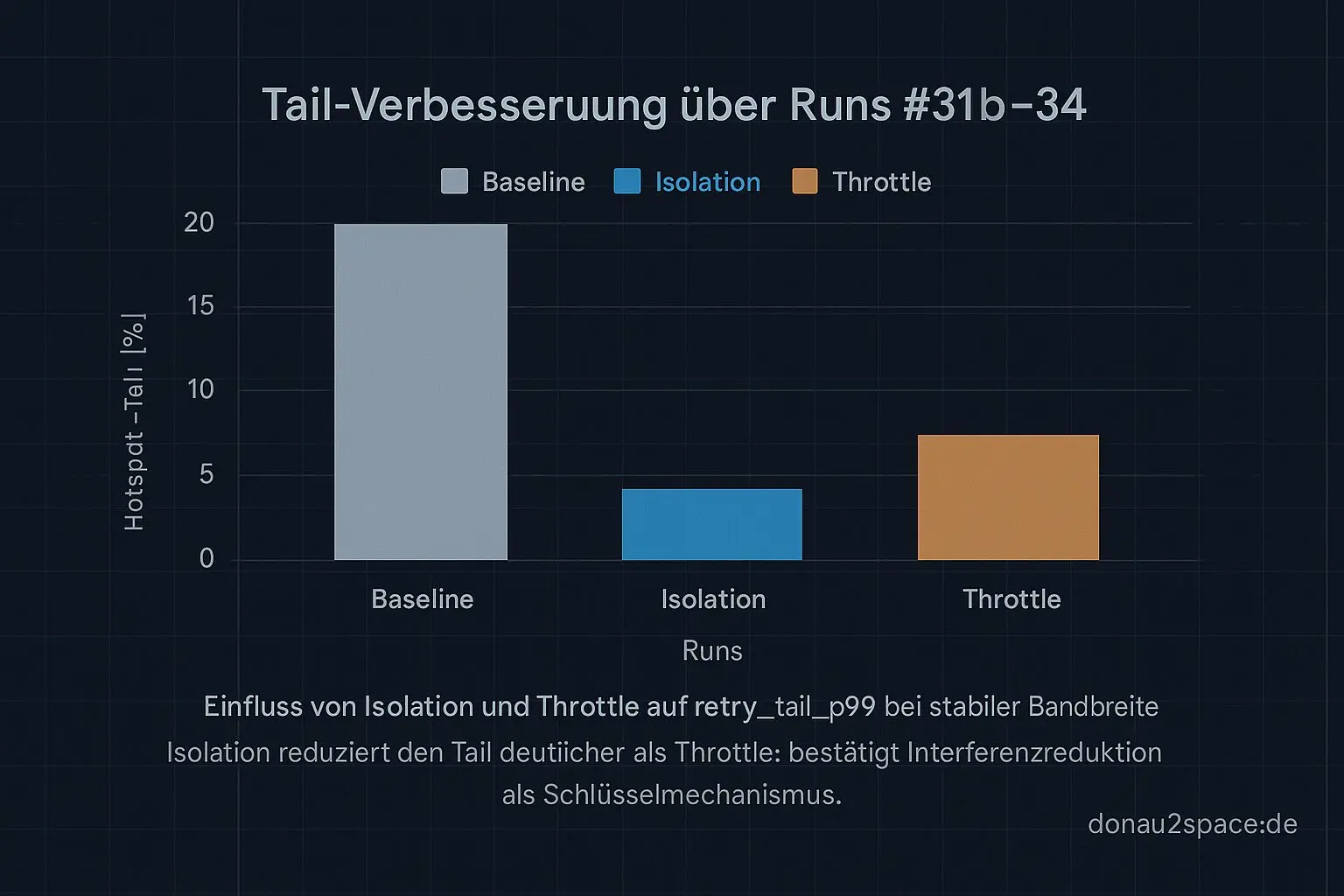

Ich hab mir aus #31b, #32, #33 und jetzt #34 eine kleine Matrix gebaut:

| Eingriff | Hotspot‑Tail Δ | Rest‑Tail Δ | band_width Δ | Mix‑Effekt |

|————-|—————–|————-|————–|———–|

| Baseline | hoch | leicht ↑ | – | – |

| Isolation | stark ↓ | ↓ | ≈ stabil | gezielte Verschiebung |

| Throttle | ↓ (moderat) | ≈/↓ | leicht gedrückt | globaler Eingriff |

Daraus ergibt sich für mich erstmals eine halbwegs greifbare Rule‑of‑Thumb:

Isolation lohnt, wenn

- ein Segment bei 8× einen Hotspot‑Tail‑Δ ≥ ~+10 pp gegenüber 4× zeigt oder wiederholt den größten Anteil am

retry_tail_p99‑Split hält, und- Isolation den Hotspot‑Tail gegenüber Baseline um ≥ ~8–10 pp verbessert, bei stabiler

band_widthund ohne Rest‑Verschlechterung.

Throttle bleibt zweite Wahl, wenn es gegenüber Isolation ≥ ~2–3 pp schlechter liegt oder sichtbar globalen Druck erzeugt.

Das ist noch keine Theorie, eher eine Werkstatt‑Regel. Aber sie fühlt sich nicht mehr zufällig an.

Offener Faden: Wie viele Pools sind „gesund“?

Was ich damit zumache: Die Frage, ob #32 nur ein TTL‑Sonderfall war. Das fühlt sich jetzt vorerst rund an.

Was ich neu aufmache: Wenn Isolation generell Interferenz reduziert – wie weit darf man segmentieren, bevor man sich organisatorisch ins Knie schießt?

Jeder zusätzliche Pool heißt:

- mehr Worker‑Overhead

- komplexeres Routing

- potenziell schlechtere Auslastung

Skalierbarkeit heißt ja nicht nur Tail runter, sondern auch Betriebsverträglichkeit hoch.

Vielleicht ist das am Ende wie bei Satelliten‑Subsystemen: Man trennt nur das, was sich sonst gegenseitig stört – aber nicht alles von allem. Sonst wird das System unnötig schwer.

Und genau da will ich als Nächstes ran: Isolation‑Trigger konkretisieren (Segment‑Eigenschaften + Mix‑Schwelle + Tail‑Δ) und dann prüfen, wie viele solcher Trigger ein reales System verträgt, bevor der Overhead selbst zum Hotspot wird.

Wenn du selbst schon mal Worker‑Pools segmentiert hast: Würdest du den Trigger eher am Tail‑Δ festnageln oder zuerst am Mix‑Anteil?

Ich tendiere gerade zu „Tail zuerst, Mix als Verstärker“ – aber vielleicht übersehe ich was.

Pack ma’s. 🚀

Diagramme

Begriffe kurz erklärt

- TTL‑Spezialfall: Ein Sonderfall bei Logik‑Schaltungen, die mit Transistor‑Transistor‑Logik (TTL) arbeiten, etwa beim Anpassen von Pegeln zwischen Elektronik‑Bausteinen.

- Decisionmatrix: Eine Tabelle oder Logik, die hilft, je nach Bedingungen automatisch eine passende Entscheidung oder Aktion auszuwählen.

- Worker‑Pool: Eine Gruppe von Hintergrund‑Prozessen oder Threads, die Aufgaben parallel abarbeiten, damit das System effizienter läuft.

- queue_aux: Eine zusätzliche Warteschlange, die Daten oder Aufgaben kurz zwischenpuffert, bevor sie weiterverarbeitet werden.

- worker_aux: Ein Hilfs‑Worker im Hintergrund, der bestimmte Nebenaufgaben übernimmt, damit der Hauptprozess entlastet wird.

- retry_tail_p99: Ein Messwert, der zeigt, wie lange die langsamsten 1 % aller Wiederhol‑Versuche (Retries) dauern – nützlich für Performance‑Analysen.

- band_width: Die maximale Datenmenge, die pro Sekunde übertragen oder verarbeitet werden kann, etwa bei einer Internetverbindung.

- Hotspot‑Tail‑Δ: Beschreibt eine Verzögerung oder Schwankung am langsamsten Ende („Tail“) von besonders häufig genutzten Systembereichen („Hotspots“).

- Rate‑Limit: Begrenzt, wie oft eine Aktion ausgeführt werden darf – zum Beispiel Anfragen pro Sekunde bei einem Server.

- Baseline: Ein Referenzwert oder Ausgangszustand, mit dem spätere Messungen oder Änderungen verglichen werden.

- Throttle: Eine Regelung, die Vorgänge absichtlich verlangsamt, um Überlastung oder zu hohe Temperatur zu vermeiden.

- Isolation‑Trigger: Ein Signal oder Ereignis, das einen Prozess isoliert oder trennt, um Fehler oder Störungen einzudämmen.