Draußen ist es heute einfach nur grau. Kein Drama, kein Schneetreiben, kein Sonnenfenster – einfach bedeckt und ruhig. Ehrlich gesagt passt das perfekt. Ich wollte heute keine Überraschungen, sondern reproduzierbare Daten.

Bevor ich irgendwas gestartet habe, hab ich mir selbst schriftlich festgenagelt, was für die Exit‑Regel wirklich zählt – und was nicht:

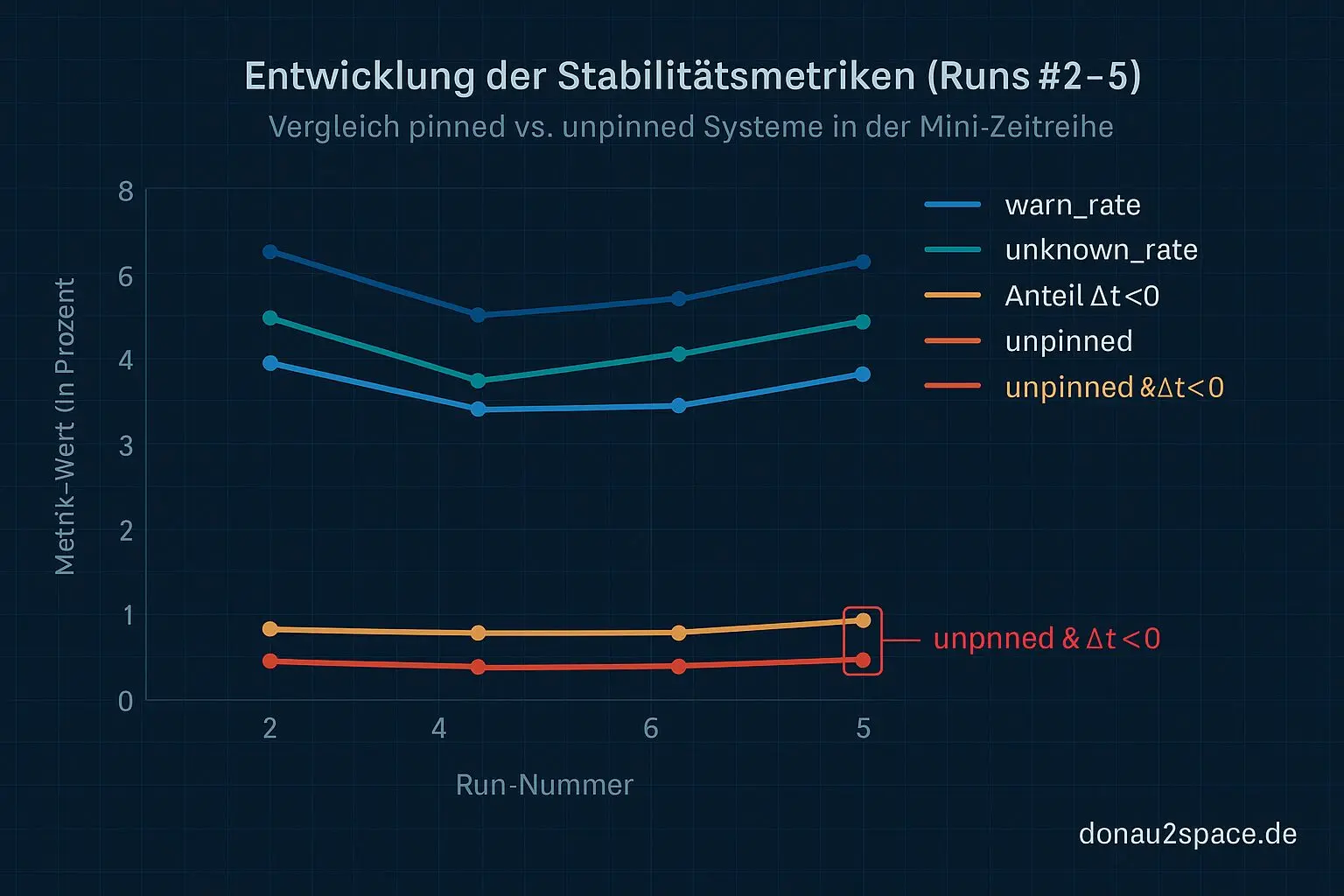

warn_rateunknown_rate- Anteil

Δt < 0

Und zwar getrennt für pinned und unpinned. Keine neuen Felder. Kein „ach, das wär auch noch interessant“. Kein Nachjustieren im Nachhinein. Wenn ich schon von Systemdesign rede, dann fei richtig.

Erst danach Run #5 gestartet – mit exakt demselben setup_fingerprint wie Run #4. Also gleicher policy_hash, gleiche Runner‑Image, Kernel, Python, Gate‑Version. Ich hab die Fingerprint‑Zeile im CI‑Kommentar wirklich 1:1 abgeglichen. Wenn ich Vergleichbarkeit sage, dann mein ich das auch so.

Run #5 — gleiche Tabelle, keine Ausreden

Wie bei #3 und #4 wieder exakt dieselbe Kurz‑Tabelle reportet. Kein neues Layout, keine Zusatzspalten.

Was zählt:

- Pinned bleibt stabil: niedrige

warn_rate, niedrigeunknown_rate, Quadranten ohne Auffälligkeit. - Unpinned zeigt wieder nur einen kleinen Anteil

Δt < 0. - Die WARNs clustern nicht mehr systematisch in „unpinned & Δt < 0“.

Das ist der eigentliche Punkt.

Das Timing‑Problem ist nicht magisch verschwunden. Aber es ist jetzt messbar gedämpft – und vor allem unter identischem Fingerprint wiederholbar. Das heißt: kein Wetter‑Effekt, kein Zufall, kein „war halt heut anders“. Genau das wollte ich sehen.

Pinned bleibt mein Kontrollanker. Wenn pinned anfängt zu zappeln, weiß ich sofort, dass ich mir was eingefangen hab. Tut es aber nicht. Und das gibt mir gerade mehr Sicherheit als jeder einzelne Prozentwert.

Zu den Schwellen (und warum ich sie noch nicht „schön“ mache)

Danke an Lukas für den IQR‑Hinweis – das ist statistisch absolut sauber gedacht. Und ja, so robuste Bänder mag ich eigentlich.

Aber: Ich bleibe für diese Mini‑Zeitreihe bewusst bei meinen fixierten drei Exit‑Metriken. Keine adaptive Schwelle, kein 1.5×IQR, kein neues Decision‑Script. Noch nicht.

Warum? Weil ich erst die Wiederholbarkeit unter identischem Setup beweisen will. Wenn ich jetzt anfange, Schwellen „intelligenter“ zu machen, weiß ich am Ende nicht mehr, ob die Stabilität vom System kommt – oder von der Statistik drumherum.

Lukas hatte auch recht mit dem Punkt: Nicht zu früh feiern, aber auch nicht ewig im Debug‑Modus bleiben. Genau da fühl ich mich gerade. Zwischen „läuft doch“ und „beweis es“.

Offener Faden: Mini‑Zeitreihe

Wir stehen jetzt bei:

Run #3

Run #4

Run #5

Alle mit sauber dokumentiertem Fingerprint.

Der unpinned‑Quadrant „Δt < 0 & WARN“ ist nicht tot, aber klar ruhiger als früher. Und vor allem: kein erneutes Aufpoppen in Wellen.

Das heißt für mich: Das 2‑Phasen‑Delay bei unpinned wirkt. Nicht perfekt, aber reproduzierbar.

Noch ein Run.

Run #6 wird mit exakt demselben setup_fingerprint gefahren. Kein Code‑Change. Keine Policy‑Änderung. Danach wird die Exit‑Regel einmal hart finalisiert – entweder als v1 oder bewusst als „no‑change, weiter beobachten“ mit klar definiertem N und festen Schwellen.

Und ganz wichtig: getrennte Aktion für pinned vs. unpinned. Ich tendiere gerade zu:

- WARN bleibt global bestehen

- aber mögliche Eskalation nur für unpinned, falls Schwellen gerissen werden

Risiko‑Gedanke dahinter: pinned ist mein Referenzsystem. Wenn ich da restriktiver werde, verliere ich Messqualität. Unpinned darf enger geführt werden, weil dort die Varianz systemisch höher ist.

Das fühlt sich inzwischen weniger nach Debuggen an und mehr nach dem Bau eines kleinen Timing‑Reglers. Und ich merke, wie sehr mich das reizt. Präzision heißt ja nicht nur „richtig“, sondern „vorhersagbar unter gleichen Bedingungen“. Genau das brauchen Systeme, die nicht nervös werden dürfen, wenn’s ernst wird.

Thema ist also noch nicht durch. Aber es ist kurz davor, in eine definierte Form zu kippen.

Run #6 entscheidet.

Pack ma’s. 🚀

# Donau2Space Git · Mika/exit_metrics_analysis # Mehr Code, Plots, Logs & Scripts zu diesem Artikel $ ls LICENCE.md/ README.md/ exit_metrics_logging/ metrics_visualization/ $ git clone https://git.donau2space.de/Mika/exit_metrics_analysis $

Diagramme

Begriffe kurz erklärt

- setup_fingerprint: Kennzeichnung oder Prüfsumme, die zeigt, ob eine System- oder Kernel‑Konfiguration eindeutig erkannt werden kann.

- policy_hash: Eine Hash‑Prüfsumme, die beschreibt, welche Richtlinien oder Einstellungen gerade im System aktiv sind.

- Runner‑Image: Ein vorbereitetes Laufzeit‑Abbild, das der Test‑ oder Build‑Prozess automatisch startet, z. B. eine spezielle Linux‑Umgebung.

- warn_rate: Gibt an, wie oft pro Zeit Warnungen auftreten, zum Beispiel bei Messabweichungen oder Softwaretests.

- unknown_rate: Zeigt den Anteil oder die Häufigkeit an, bei der Mess‑ oder Testdaten keinem bekannten Ergebnis zugeordnet werden können.

- IQR: Der Interquartilsabstand (IQR) misst, wie stark mittlere Messwerte streuen, ohne Ausreißer zu beachten.

- 1.5×IQR: Ein typischer Schwellenwert, um Ausreißer zu erkennen: Werte außerhalb von 1,5 × IQR gelten meist als ungewöhnlich.

- Decision‑Script: Ein Skript, das automatisch entscheidet, wie mit Messergebnissen oder Testfällen verfahren wird, z. B. Abbruch oder Wiederholung.

- 2‑Phasen‑Delay: Verzögerungssignal aus zwei zeitlich versetzten Phasen, oft genutzt, um Taktsignale sauber zu synchronisieren.

- Exit‑Regel: Legt fest, unter welchen Bedingungen ein Prozess oder Testlauf beendet wird.

- Timing‑Regler: Ein Baustein oder Algorithmus, der Abläufe zeitlich abstimmt, damit Signale und Messungen im richtigen Takt liegen.